Del 3 al 5 de noviembre de 2025, Australia fue sede por primera vez de la reunión anual de líderes digitales de la OCDE, conocida como el OECD E-Leaders Meeting, junto con el Grupo Experto de la OCDE sobre Datos Abiertos del Gobierno. Alrededor de 60 delegados de unos 20 países se reunieron para discutir cómo la inteligencia artificial (IA), los datos y la digitalización están transformando los gobiernos.

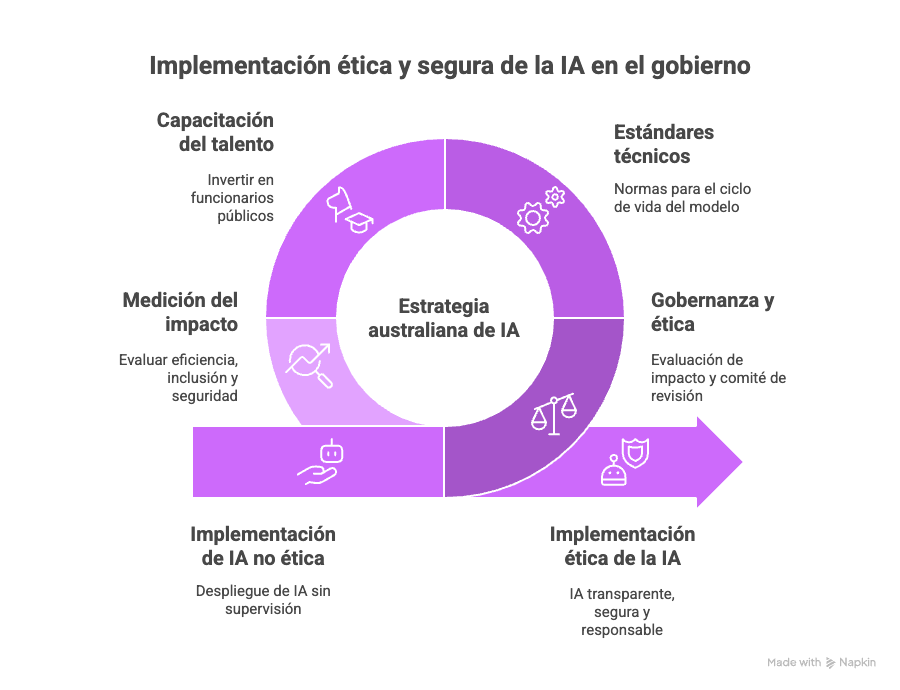

Australia presentó una estrategia sólida para incorporar IA en el servicio público con un enfoque equilibrado: innovación con responsabilidad. No se trata de desplegar algoritmos a lo loco, sino de asegurar que cada paso esté respaldado por estándares éticos, transparencia y una evaluación clara de riesgos.

Estrategia australiana: innovación con límites claros

Australia no improvisó. Su gobierno desarrolló un plan estructurado para la IA pública que enfatiza tres dimensiones clave:

- Gobernanza y ética

Cada proyecto de IA debe pasar por una evaluación de impacto. Además, existe un comité especializado que revisa los desarrollos de IA más sensibles para garantizar rendición de cuentas. - Estándares técnicos

Hay normas específicas que guían todo el ciclo de vida de los modelos: desde el diseño y entrenamiento hasta su despliegue y monitoreo. Las agencias deben publicar declaraciones de transparencia sobre qué IA usan y cómo la controlan. - Capacitación del talento

El gobierno está invirtiendo en su propio personal: funcionarios públicos reciben formación para entender, diseñar y supervisar soluciones de IA. La innovación no depende solo de los proveedores externos, sino del fortalecimiento interno

Resultados y desafíos

- Mejora de procesos. Varias agencias ya utilizan IA para automatizar tareas repetitivas, detectar fraudes o modelar políticas públicas. Esto libera tiempo del personal para tareas de mayor valor y permite tomar decisiones más informadas.

- Transparencia. Al exigir que los organismos publiquen cómo y para qué usan IA, Australia reduce la opacidad y fortalece la confianza ciudadana.

- Seguridad. El país también ha reforzado su infraestructura digital. En el contexto de amenazas cibernéticas crecientes, sus políticas defienden que los modelos de IA sean tratados como activos críticos, con registro de uso, auditoría continua y planes de retroceso ante fallas.

- Medición del impacto. No basta con desplegar IA: se deben medir los resultados reales. Australia ya está trabajando en métricas para evaluar eficiencia, inclusión, seguridad y cumplimiento de objetivos a largo plazo.

Aun así, los retos persisten. La IA no está exenta de sesgos, ni de riesgos reputacionales si no se gestiona con cuidado. Además, aunque los principios éticos existen, su aplicación práctica exige vigilancia constante.

Lecciones para México

México vive un momento de digitalización muy relevante. Con iniciativas como Llave MX y una apuesta clara por modernizar trámites, el país podría inspirarse en la experiencia australiana.

La narrativa que Australia ha escrito estos días demuestra que no basta con adoptar IA: es esencial acompañarla de un plan estratégico claro, donde cada dependencia sepa cómo incorporar de forma ética y segura. Instaurar un mecanismo de supervisión fuerte, como un comité que revise los proyectos más riesgosos, podría ayudar a México a equilibrar innovación y protección ciudadana.

Además, la transparencia pública es clave: explicar a la ciudadanía qué modelos se usan, para qué y con qué salvaguardas puede construir confianza. México también podría invertir en su propio talento, capacitando a funcionarios para diseñar, evaluar y auditar sistemas de IA, de modo que la transformación digital sea más sostenible, menos dependiente de consultores externos.

Finalmente, lanzar pilotos controlados antes de hacer un despliegue masivo es una estrategia que minimiza riesgos y permite aprender lecciones. Esa forma gradual de avanzar, pero con visión de largo plazo, puede hacer la diferencia.

Last modified: 16 de diciembre de 2025