La inteligencia artificial ya toma decisiones que afectan la vida de los mexicanos: asigna apoyos sociales, filtra solicitudes de crédito en plataformas gubernamentales, prioriza atención médica en hospitales públicos y hasta determina perfiles de riesgo en sistemas de seguridad. Sin embargo, cuando un ciudadano pregunta por qué un algoritmo lo excluyó de un programa, la respuesta casi siempre es la misma: silencio institucional. México escala su apuesta por la IA pública sin haber resuelto una pregunta elemental: ¿quién protege los datos personales cuando la máquina decide?

El problema de fondo: una ley que no alcanza al algoritmo

La Ley Federal de Protección de Datos Personales en Posesión de los Particulares fue promulgada en 2010, mucho antes de que la IA generativa, el aprendizaje automático o los modelos de lenguaje grande entraran al vocabulario gubernamental. Su equivalente para el sector público, la Ley General de Protección de Datos Personales en Posesión de Sujetos Obligados, es de 2017 y tampoco contempla los desafíos que plantean los sistemas automatizados de toma de decisiones.

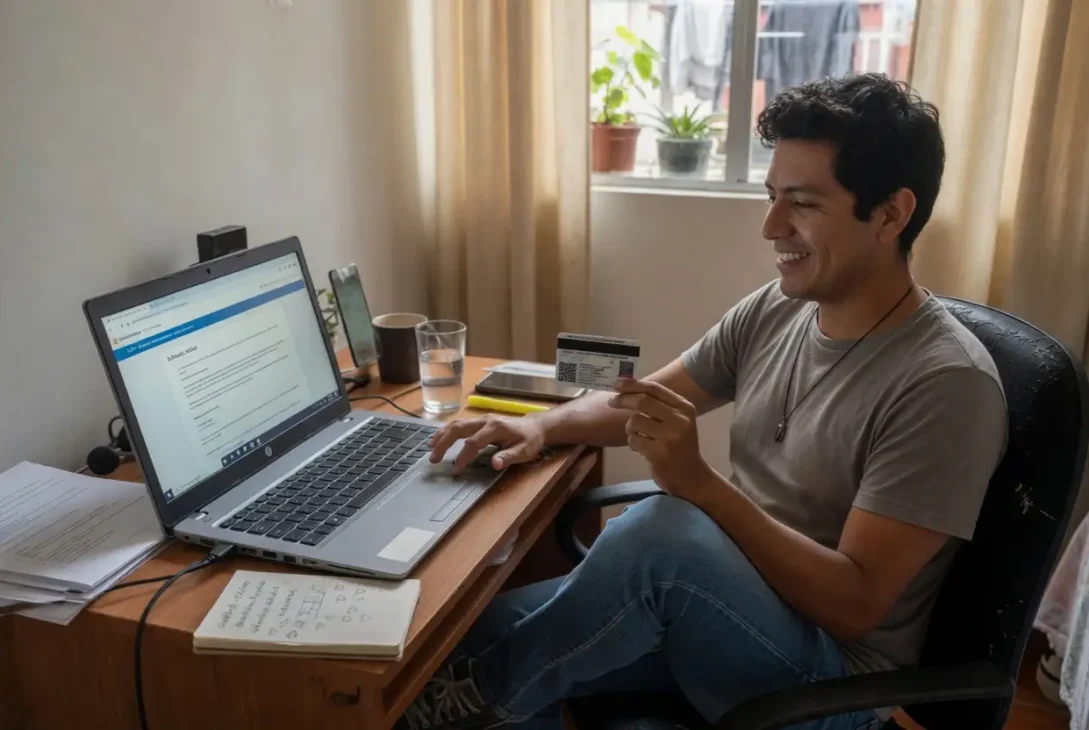

El problema no es menor. Cuando un sistema de IA procesa datos personales para decidir si alguien califica para un beneficio social, si merece un crédito o si representa un riesgo de seguridad, no aplica las garantías tradicionales del derecho a la privacidad: no hay aviso de privacidad claro, no existe un mecanismo de oposición efectivo, y el derecho a explicación —saber por qué la máquina tomó esa decisión— simplemente no está codificado en ninguna norma mexicana vigente.

Especialistas en política digital advierten que esta ausencia no es solo un problema jurídico formal. Es un problema de confianza ciudadana. Si los mexicanos no saben cómo se usan sus datos en sistemas automatizados, difícilmente confiarán en los servicios digitales del Estado, lo que frena precisamente la adopción que el gobierno busca acelerar.

Reconfiguración institucional sin brújula regulatoria

El escenario se complica con la desaparición del INAI, el organismo garante de la transparencia y protección de datos en México. Su función fue absorbida por la Secretaría Anticorrupción y Buen Gobierno, lo que genera incertidumbre sobre la autonomía real del nuevo esquema de supervisión.

Para el gobierno digital, esta transición institucional llega en el peor momento posible: justo cuando los sistemas de IA proliferan en dependencias federales y estatales. Sin un órgano regulador robusto, independiente y con capacidad técnica para auditar algoritmos, el riesgo de que los sesgos en los datos de entrenamiento se traduzcan en discriminación sistémica es muy real.

Un sistema de IA entrenado con datos históricos de asignación de crédito, por ejemplo, puede perpetuar patrones de exclusión hacia mujeres, comunidades indígenas o zonas rurales, no porque el programador lo haya diseñado así, sino porque los datos reflejan inequidades estructurales. Sin auditorías obligatorias de impacto algorítmico, estos sesgos pasan desapercibidos hasta que el daño social ya es considerable.

Lo que falta: el estándar internacional como espejo

La Unión Europea aprobó en 2024 el Reglamento de IA, el primero en su tipo a nivel mundial, que clasifica los sistemas de IA según su nivel de riesgo y establece obligaciones específicas para los de alto riesgo —precisamente los usados en servicios públicos esenciales—, incluyendo evaluaciones de impacto, registros de transparencia y el derecho ciudadano a no ser sometido a decisiones puramente automatizadas sin revisión humana.

México no tiene equivalente. Lo que existe son iniciativas legislativas en proceso, como la que impulsa la Comisión de Ciencia y Tecnología del Senado, que busca un marco normativo para la IA con énfasis en derechos humanos y privacidad, pero que aún no avanza con la urgencia que el contexto demanda.

Los expertos proponen, como mínimo, cuatro mecanismos que cualquier regulación mexicana debería contemplar: evaluaciones de impacto algorítmico antes del despliegue de sistemas de IA en servicios públicos; registros públicos de los sistemas automatizados en uso por dependencias gubernamentales; el derecho a explicación para cualquier ciudadano afectado por una decisión automatizada; y auditorías independientes periódicas con capacidad técnica real para revisar los modelos en funcionamiento.

El riesgo de escalar sin cimientos

México no puede darse el lujo de esperar. El Plan Nacional de Conectividad 2026-2030 busca extender el acceso digital a más de 1.4 millones de personas adicionales, lo que amplía exponencialmente la cantidad de ciudadanos que interactuarán con servicios públicos digitales —y potencialmente con sistemas de decisión automatizada.

Escalar la conectividad sin fortalecer simultáneamente la protección de datos equivale a abrir más puertas sin instalar cerraduras. La confianza digital no se construye solo con mejores plataformas o trámites más ágiles; se construye cuando el ciudadano sabe que sus datos están protegidos, que los algoritmos son auditables y que tiene recursos efectivos cuando una máquina toma una decisión que lo perjudica.

El momento de cerrar ese vacío regulatorio no es después de escalar la IA pública. Es ahora, antes de que los sistemas se consoliden y el daño sea más difícil de revertir.

auditoría algorítmica datos personales decisiones automatizadas derechos digitales Gobierno Digital gobierno electrónico IA en México INAI Inteligencia Artificial Politica Pública privacidad digital regulación IA México sector público transformación digital vacío regulatorio

Last modified: 6 de mayo de 2026